Welche Rolle spielen generative Engines in der neuen Web-Architektur?

Kurzfassung: Die Integration von generative Engines verändert die Web-Architektur grundlegend: Anfragen werden zerlegt, Inhalte werden als Embeddings verarbeitet und Antworten kombinieren Trainingswissen mit Echtzeit-Retrieval. Große Akteure wie Google, OpenAI, Microsoft und Perplexity prägen die Infrastruktur und zwingen Unternehmen, Inhalte technisch neu aufzubereiten, um in KI-Antworten sichtbar zu bleiben.

Wie generative Engines die technische Basis der Web-Architektur verändern

Moderne KI-Systeme behandeln eine Nutzerfrage nicht mehr als einzelne Suchanfrage, sondern als Serie von Teilfragen. Dieser Prozess der Query Decomposition (auch «Query Fan-Out» genannt) ist einer der ersten Schritte in der neuen Web-Architektur.

Technische Abläufe: Chunking, Embeddings und Vektordatenbanken

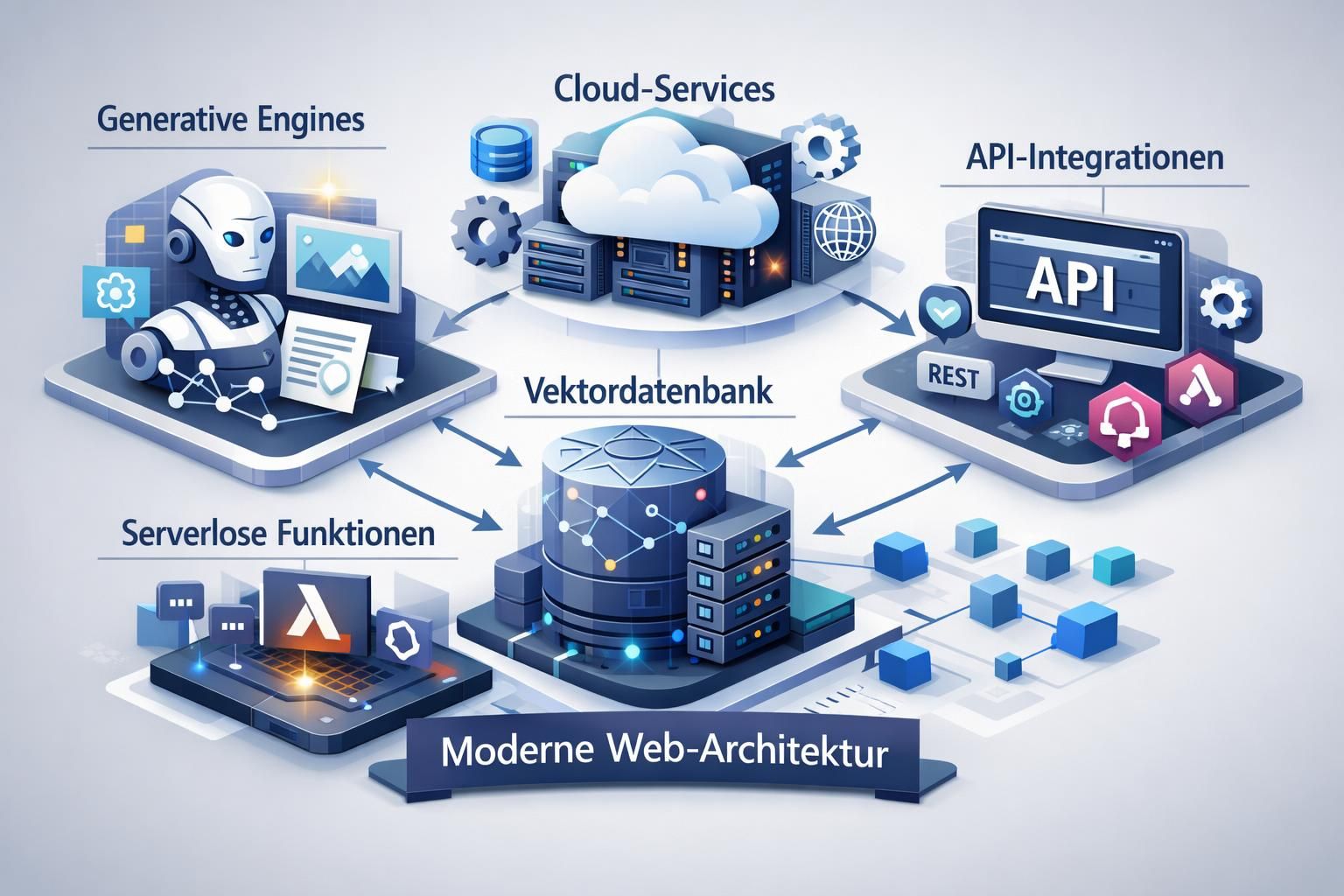

Inhalte werden vorab in kleinere Passagen zerlegt (Chunking) und in mathematische Vektoren übersetzt (Embeddings). Diese Vektoren ermöglichen semantische Vergleiche in Vektordatenbanken oder Knowledge Graphs. Anbieter wie Google dokumentieren Teile dieses Ablaufs in ihren Entwicklerressourcen; weiterführende Erklärungen zu Embeddings finden sich im Google Machine Learning Crash Course.

Für Betreiber digitaler Plattformen bedeutet das: technische Architekturen müssen auf Cloud Computing, Serverless-Funktionen, Microservices und standardisierte API-Integration ausgelegt sein, um Inhalte effizient zu chunking und Embeddings bereitzustellen. Das Ergebnis ist eine stärkere Automatisierung der Datenverarbeitung und engere Verzahnung zwischen Inhaltsverwaltung und KI-Retrieval.

Schlussfolgerung: Die Anforderungen an Infrastruktur steigen, wer nicht skaliert, verliert Sichtbarkeit.

Retrieval, Grounding und die Abhängigkeit von Suchinfrastrukturen

Generative Systeme kombinieren zwei Quellen: das langfristig gelernte Wissen aus Trainingsdaten und aktuelle Informationen aus dem Web via Retrieval. Dieser Mechanismus heißt Retrieval-Augmented Generation (RAG) und ist zentral für die Zuverlässigkeit generierter Antworten.

Plattformen, Indizes und empirische Befunde

Untersuchungen zeigen unterschiedliche Indexnutzungen: Google AI Overviews greifen auf den Google-Index, Perplexity betreibt einen eigenen Crawler (PerplexityBot) und Index, während hybride Angebote wie ChatGPT Search in Tests teils auf Bing- oder Google-indizes zurückgreifen. Studien von Backlinko, ACME.BOT und unabhängigen Analysen im Sommer 2025 deuten auf hybride, oft wechselnde Architekturen hin.

Das hat Folgen für klassisches SEO: Ohne Indexierung und strukturierte, maschinenlesbare Inhalte können Seiten selten als Quellen in KI-Antworten erscheinen. Die Forscher Aggarwal et al. definierten 2023/2024 erstmals das Feld der Generative Engine Optimization (GEO), das gezielte Maßnahmen beschreibt, um in KI-Antworten zitiert zu werden.

Schlussfolgerung: Wer Sichtbarkeit in generative Engines erreichen will, muss sowohl für Suchindizes als auch für semantische Retrieval-Pipelines optimieren.

Operative Konsequenzen für Unternehmen: GEO, Messung und Architekturentscheidungen

GEO ergänzt, ersetzt aber nicht klassisches SEO. Forschungsergebnisse zeigen, dass Maßnahmen wie das Einfügen verifizierbarer Statistiken, Quellenverlinkungen und gut strukturierter, extrahierbarer Text die Zitierwahrscheinlichkeit in generativen Antworten signifikant erhöhen.

Strategien, Tools und Architekturoptionen

Praxisbausteine umfassen semantische Content-Architekturen, Autoritätssignale (E‑E‑A‑T), strukturiertes HTML und JSON‑LD-Schema sowie gezielte Plattformpräsenz. Tools wie Peec AI, Profound oder Otterly messen die Share of Voice in KI-Antworten; unternehmensinterne Dashboards erfassen Zitathäufigkeit und Referrer-Traffic aus KI-Systemen.

Auf technischer Ebene stützen sich erfolgreiche Umsetzungen auf Cloud Computing-Infrastruktur, Serverless-Workloads zur Echtzeit-Embeddings-Erzeugung, Microservices für modulare Retrieval-Pipelines und robuste API-Integration zu Vektordatenbanken. Diese Kombination ermöglicht Automatisierung bei der Datenverarbeitung und schnellere Anpassung an Plattformänderungen.

Schlussfolgerung: Unternehmen müssen Inhalte, Technik und Monitoring synchronisieren, um in der neuen Web-Architektur relevant zu bleiben.