Autonome KI-Agenten prägen das digitale Ökosystem zunehmend als operative Schicht zwischen Nutzerinteraktionen und Backend-Prozessen. Zahlreiche Pilotprojekte und technische Leitfäden beschreiben heute, wie diese Systeme LLMs, APIs, Speicher und Guardrails orchestrieren, um komplexe Geschäftsprozesse zu automatisieren und die Datenverarbeitung zu beschleunigen.

Dieser Artikel fasst den Stand der Technik, konkrete Einsatzfelder und die zentralen Risiken zusammen und erläutert, welche Konsequenzen Künstliche Intelligenz-gestützte Agenten für Unternehmen und Plattformen haben.

Autonome KI-Agenten im digitalen Ökosystem: Aufbau und technische Prinzipien

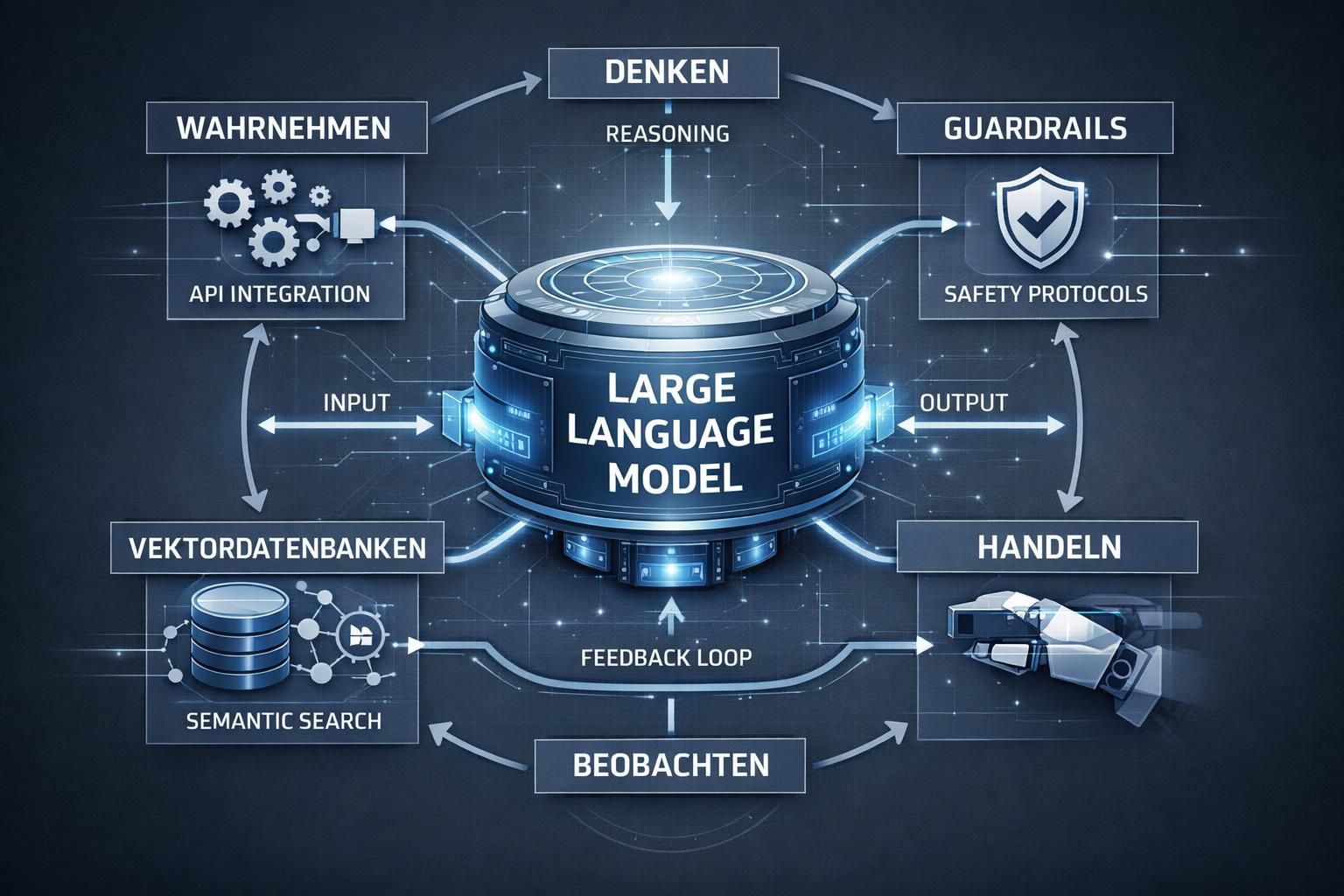

Technisch basieren autonome KI-Agenten auf einer Wahrnehmungs–Denk–Handlungs–Beobachtungs‑Schleife. Das System nimmt Eingaben auf, formuliert mithilfe eines LLM einen Plan, ruft spezialisierte Tools oder APIs auf und bewertet die Resultate gegen vordefinierte Guardrails.

Architektur und Komponenten für zuverlässige Ausführung

Ein Agent kombiniert vier Kernmodule: das LLM als Entscheidungsinstanz, Kurz- und Langzeit‑Speicher (Vektordatenbanken), eine Toolbox aus internen und externen APIs sowie ein Orchestrierungs‑Layer. Dokumentationen zur technischen Struktur von Agenten bieten tiefergehende Erläuterungen, etwa zur Rolle von Prompt‑Engineering und Observability.

Mehr technische Details finden sich in Fachbeiträgen zur technischen Struktur von KI-Agenten, die Implementierungsfragen und Sicherheitsmechanismen darlegen.

Einsatzfälle, Praxisbeispiele und gesicherte Ergebnisse

In Logistik, Reisebranche, Versicherung und Customer Service zeigen Piloten, wie Agenten Routineaufgaben übernehmen und Abläufe straffen. Ein exemplarisches Logistikprojekt automatisierte Sendungsverfolgung und Kundenkommunikation, koordinierte mehrere interne APIs und reduzierte die Bearbeitungszeit von Anfragen signifikant.

Konkrete Effekte und Geschäftskennzahlen

Solche Projekte demonstrierten in der Praxis eine Reduktion manueller Supportzeiten um bis zu 40 % sowie eine konsistentere Kundenkommunikation durch persistent gespeicherte Interaktionsdaten. Agenten vom Typ Query‑Planning oder Tool‑Use ermöglichen es, Informationen aus RAG‑Vektordatenbanken, Dokumentenindizes und Fach‑APIs zusammenzuführen.

Die Kombination aus Maschinelles Lernen, Prozessautomatisierung und modularen Integrationen erlaubt schnelle Iterationen: Start mit einem einzelnen, validierten Agenten, bevor auf protokollierte Multi‑Agenten‑Systeme skaliert wird.

Sicherheit, Interoperabilität und Auswirkungen auf Geschäftsmodelle

Die Verbreitung agentischer Systeme erhöht Anforderungen an Interoperabilität und Governance. Ohne standardisierte Protokolle drohen Inkonsistenzen im Agenten‑zu‑Agent‑Austausch; deshalb gewinnen Modelle wie Model Context Protocols an Bedeutung.

Risiken, Guardrails und Regulatorik

Angriffe wie Prompt‑Injection oder Vector‑Poisoning zwingen zu mehrschichtigen Sicherheitsmaßnahmen: RBAC für Tool‑Aufrufe, JSON‑Validierung, Sandboxen und Observability‑Dashboards zur Vorfallanalyse. In regulierten Branchen bleibt die Frage der Verantwortlichkeit zentral: welche Entscheidungen darf ein Agent autonom treffen?

Für Werbetreibende und Publisher verändert sich die Sichtbarkeit im Web: Agents liefern prägnante Antworten statt Linklisten, was neue Monetarisierungsformen erfordert und die Gestaltung von Werbeformaten beeinflusst.

Ausblick für Unternehmen und nächste Schritte

Organisationen sollten mit modularen Open‑Source‑Piloten starten, einen einzelnen Agenten validieren und Observability sowie Guardrails früh integrieren. Die Kombination aus Netzwerke von spezialisierten Agenten und klaren Governance‑Protokollen wird entscheiden, ob die technologische Innovation sicher skaliert.

Wer jetzt Prozesse mit hohem Volumen automatisiert, legt den Grundstein für Wettbewerbsvorteile: höhere Skalierbarkeit, niedrigere Betriebskosten und schnellere Entscheidungszyklen durch autonome Systeme im digitalen Ökosystem.